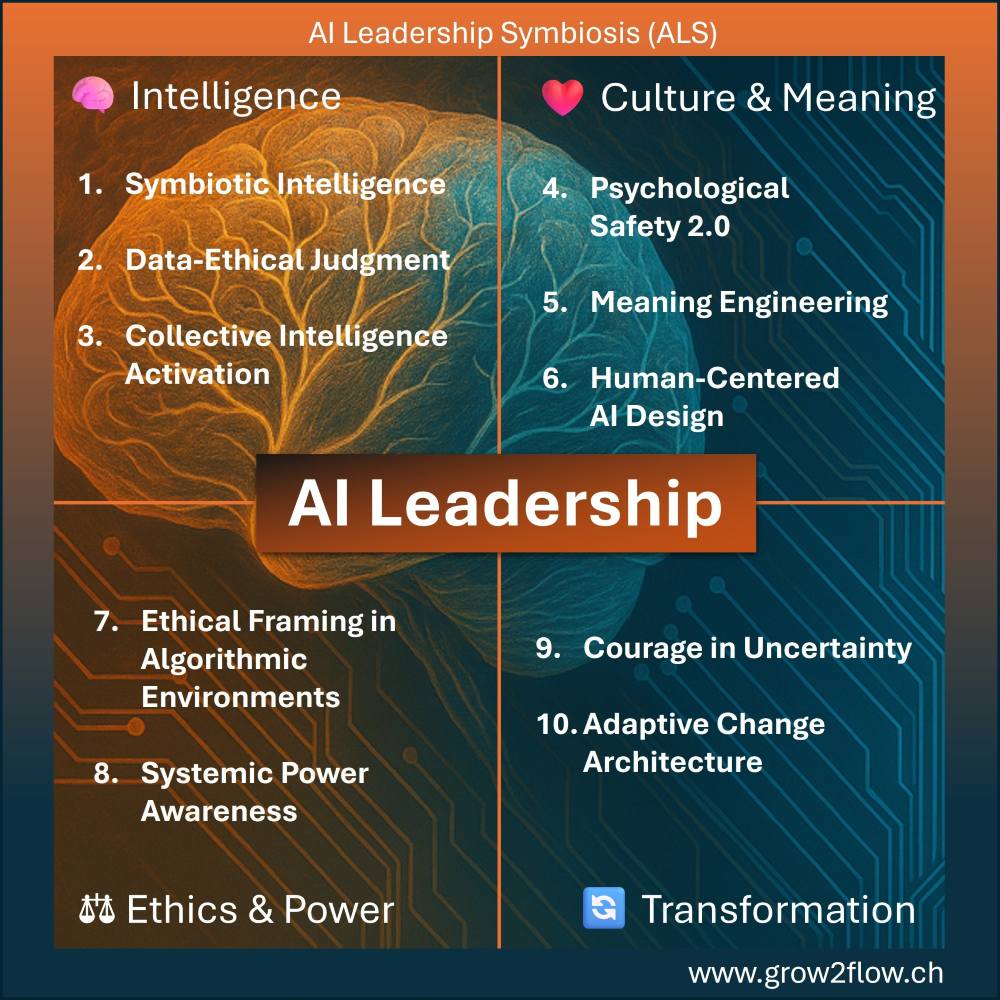

The next generation of leadership will not be chosen for charisma alone, nor for operational excellence in a stable world. It will be chosen for its capacity to think, decide and act in symbiosis with artificial intelligence. This is the central thesis behind the ten capabilities of AI Leadership as outlined in the framework of AI Leadership Symbiosis.

We are entering an era in which intelligence is no longer the sole preserve of humans. Algorithms analyse, predict and recommend. Systems learn. Data speaks for itself. Yet responsibility remains deeply human. It is in this tension between augmentation and accountability that a new form of leadership emerges. It is neither technocratic nor romantic. It is relational. It is systemic. It is ethical. It is symbiotic.

Symbiotic intelligence marks the beginning of this shift. Leadership moves from authority to augmentation. Decisions are no longer made in isolated egos but in hybrid systems in which human judgment and artificial pattern recognition interact. The leader of the future orchestrates this interaction consciously. She understands that AI is not a tool at the margins but a cognitive partner within the decision architecture of the organization. The question is no longer who decides but how decision systems are designed.

With this orchestration comes responsibility for data ethical judgment. Beyond data fluency lies data conscience. It is not enough to read dashboards and interpret correlations. Leaders must reflect on the origin of data, on distortions, on embedded biases and on downstream consequences. Bias management becomes a management task. Ethical literacy becomes strategic literacy. In the ALS perspective this is not an add on. It is a core capability because data shapes reality long before decisions become visible.

Collective intelligence activation extends the horizon further. AI can amplify not only efficiency but resonance. Used wisely it opens spaces for shared reflection, distributed sensing and co creation. The shift is from individual brilliance to systemic resonance. AI becomes a medium that connects perspectives rather than a mechanism that centralizes control. In this sense AI Leadership Symbiosis understands technology as a catalyst for collective learning rather than a substitute for human dialogue.

Culture is transformed as well. Psychological safety evolves into what can be called Psychological Safety 2.0. Trust is no longer built only between people but also in the way algorithmic systems are introduced and governed. Transparency becomes a management tool. Leaders must explain not only their intentions but also the logic of the systems that inform their decisions. Without transparency hybrid teams fracture. With transparency they mature.

Meaning engineering addresses a deeper layer. As AI takes over repetitive and cognitively demanding tasks it relieves pressure but also destabilizes identities. Work changes. Roles dissolve. Narratives are questioned. Leadership therefore provides direction, dignity and narrative embedding. It interprets transformation in a way that preserves human significance. Meaning does not arise automatically from efficiency. It must be consciously cultivated.

Human centered AI design follows from this anthropological stance. Technology follows anthropology, not the other way around. Leaders shape the implementation of AI in participatory ways. They design systems with an awareness of human complexity, vulnerability and aspiration. In the ALS model this design attitude reflects a broader commitment to aligning technological progress with human development rather than subordinating people to optimization logics.

Ethical framing in algorithmic environments becomes indispensable. Not everything that can be optimized should be optimized. Decision spaces are shaped normatively whether we acknowledge it or not. Here discourse matters more than dashboards. Habermas becomes more relevant than KPIs. Leaders must be capable of articulating the values embedded in algorithmic architectures and of facilitating discourse about them. AI Leadership Symbiosis situates leadership within communicative rationality, not merely instrumental rationality.

Systemic power awareness sharpens the lens. Power shifts through data. Visibility creates influence. Algorithms privilege certain metrics and silence others. Leaders who fail to see these invisible structures become unwitting executors of hidden agendas. Leaders who recognize them can consciously shape them. In a data driven world power is architectural. It is encoded in systems long before it is exercised in meetings.

Courage in uncertainty remains profoundly human. AI provides probabilities, simulations and forecasts. It reduces ambiguity but never eliminates it. Decisions must still be taken without full clarity. Responsibility cannot be automated. Courage remains non automatable. In the ALS perspective courage is not recklessness but the willingness to assume accountability in hybrid constellations of intelligence.

Finally adaptive change architecture reframes transformation itself. Change is no longer managed as a temporary disruption. It becomes a permanent design condition. Organizations evolve into learning systems in which AI functions as a co sensor, continuously detecting patterns and anomalies. Leadership designs the architecture within which adaptation becomes normal. Stability arises not from rigidity but from dynamic coherence.

All ten capabilities form an integrated field. Intelligence, culture and meaning, ethics and power, transformation. They are not isolated competencies but dimensions of a new leadership paradigm. AI Leadership Symbiosis proposes that the future of leadership lies in consciously shaping the interplay between human and artificial intelligence in service of human flourishing and organizational resilience.

In service of the question remains the guiding attitude. In a world where intelligence is no longer exclusively human how can we lead responsibly, ethically and effectively.

This question does not seek quick answers. It seeks reflective practitioners, courageous decision architects and systemic thinkers.

AI Leadership Symbiosis is an invitation to develop these capabilities deliberately. It is not about replacing leaders with algorithms. It is about elevating leadership to a level where human and artificial intelligence co create value, meaning and direction together.